Claude Opus 4.7이 AI 코드 리뷰에서 의미하는 것

해당 블로그는 Juan Pablo Flores 원저자의 글 'What Claude Opus 4.7 means for AI code review'을 번역한 것입니다. 더 나은 이해를 위해서 약간의 의역이 반영되었습니다.

금요일에 머지된 PR이 새벽 2시에 누군가를 호출하는 버그로 돌아오는 경험, 다들 한 번쯤 있으시죠. 40개 파일짜리 PR을 정신없이 훑던 리뷰어가 놓친 그 버그. 세 단계 깊이의 파일에 묻혀 있던 그 레이스 컨디션. AI 코드 리뷰는 바로 그 격차를 메우기 위해 만들어졌고, Claude Opus 4.7과 함께 그 격차는 또 한 번 좁혀졌습니다.

CodeRabbit의 리뷰 엔진은 단일 모델에 의존하지 않습니다. 저희는 여러 연구소의 프론티어 모델로 구성된 앙상블(ensemble) 을 운영하며, 리뷰 파이프라인의 단계별 특성에 따라 서로 다른 모델을 선택해 사용합니다. 각 모델은 실제 코드를 대상으로 한 평가를 통과해야만 자리를 차지할 수 있습니다. 새로운 프론티어 모델이 나오면, 저희는 현재 앙상블에 포함된 모든 모델과 정면 비교(head-to-head) 벤치마크를 돌려, 어디서 우월하고 어디서 그렇지 않은지를 검증합니다.

이번에 CodeRabbit의 프로덕션 코드 리뷰 파이프라인을 기준으로 Opus 4.7을 테스트했습니다. 결과는 미미한 개선이 아니었습니다. 다양한 실제 오픈소스 풀 리퀘스트(PR)에 걸친 100개의 평가 포인트(evaluation points) 를 대상으로 정면 비교를 수행했고, Claude Opus 4.7은 더 많은 실제 버그를 발견하고, 더 실행 가능한(actionable) 피드백을 생성하며, 파일 간 추론에서도 그동안 저희가 테스트한 어떤 모델보다 뛰어난 결과를 보였습니다.

CodeRabbit이 모델을 평가하는 방식

결과를 보기 전에, 저희가 코드 리뷰 모델을 어떻게 벤치마킹하는지부터 짚고 갈 필요가 있습니다. 결과만큼이나 방법론도 중요합니다.

저희의 평가 프레임워크는 저희가 에러 패턴(Error Patterns, EP) 이라 부르는 개념을 중심으로 구성됩니다. 주요 오픈소스 프로젝트의 실제 PR에서 추출한 검증된 100개의 알려진 이슈 모음입니다. 각 EP는 실제 PR의 특정 이슈와 1:1로 매핑됩니다. 예를 들면 Go 서비스의 레이스 컨디션, React 컴포넌트의 누락된 null 체크, Rails 컨트롤러의 인가(authorization) 우회 같은 것들이죠.

테스트하는 모든 모델에 대해 저희는 네 가지 핵심 지표를 측정합니다.

- 합격률(Pass rate): 모델이 알려진 이슈를 잡아냈는가?

- 실행 가능성(Actionability): 피드백이 개발자에게 정확히 무엇을 고쳐야 하는지 알려주는가?

- 코멘트 품질(Comment Quality): 심각도(severity)를 올바르게 분류하는가? 출력은 잘 구조화되어 있고, 코드 근거가 충분한가?

- 신호 대 잡음비(Signal-to-noise): 잡음 대비 유용한 피드백을 얼마나 만드는가?

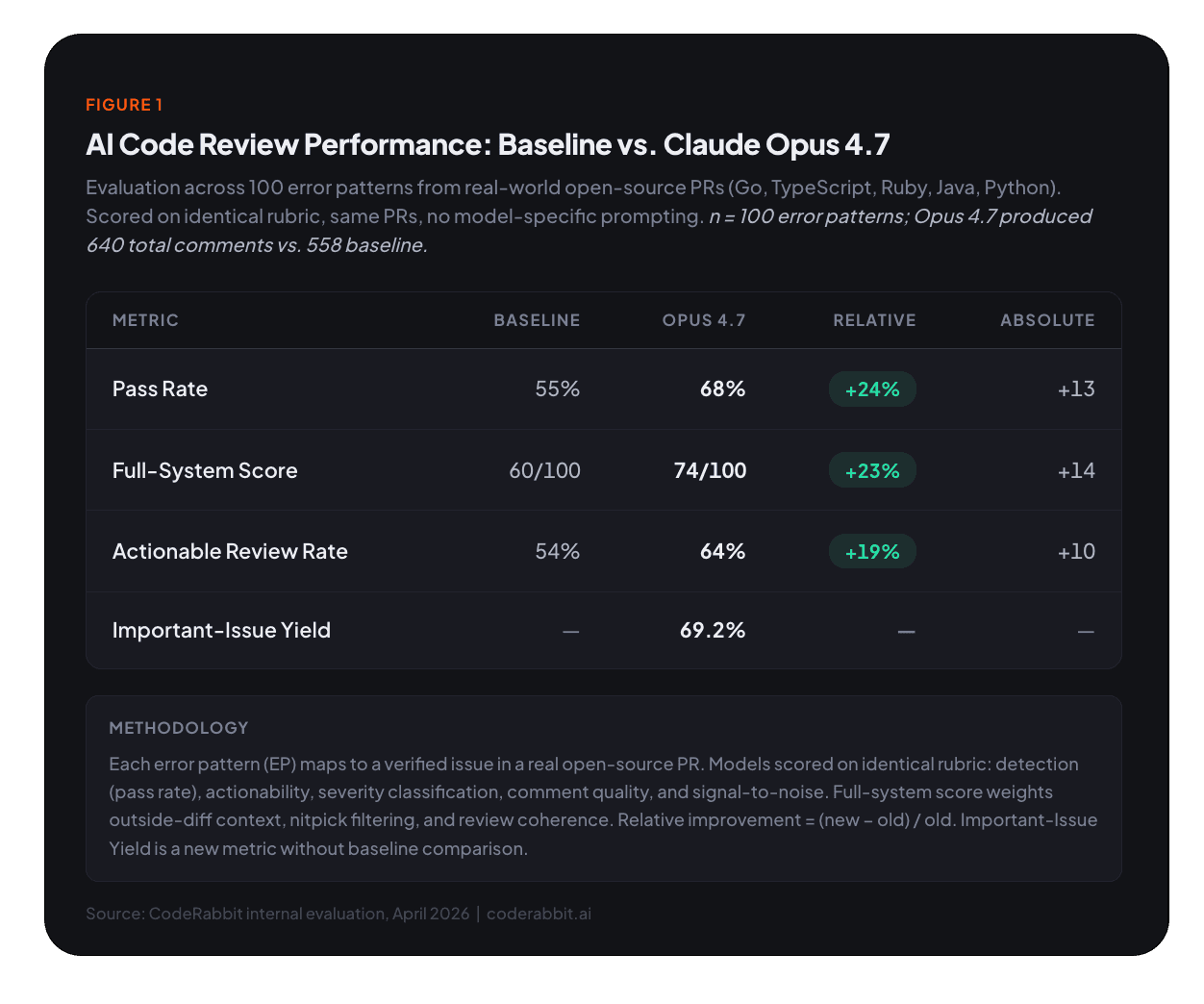

Opus 4.7은 동일한 100개의 EP, 동일한 PR, 동일한 채점 기준을 사용해 현재 프로덕션 베이스라인과 동일선상에서 평가했습니다. 체리피킹 없음, 한쪽에 유리한 특별 프롬프팅 없음.

코드 리뷰에서의 모델 성능

Opus 4.7을 CodeRabbit에 통합한 결과, 저희가 추적하는 다양한 지표 전반에서 리뷰 품질이 크게 점프했습니다.

합격률(Pass rate)

핵심 평가 지표인 "주어진 PR에서 알려진 이슈를 잡았는가"에서, Opus 4.7을 통합한 CodeRabbit의 현재 코드 리뷰 하니스(harness)는 100개의 평가 포인트 중 68개를 통과했습니다. 베이스라인의 55개 대비 상대 개선율 24%. 모델이 "정말로 중요한 그 버그"를 찾는 능력에 대한 직접적인 향상입니다.

실무 관점에서 환산해 봅시다. 매주 20건의 PR을 머지하는 팀이 있고, 각 PR에 최소 한 개의 리뷰 가능한 이슈가 있다고 가정해 보죠. 베이스라인 모델로는 약 11건의 이슈가 잡힙니다. Opus 4.7로는 그 수치가 거의 14건까지 올라갑니다. 분기 단위로 환산하면 프로덕션에 도달하기 전에 추가로 잡히는 버그가 약 36건 더 늘어나는 셈입니다.

풀 시스템 점수(Full-system score)

전체 점수 시스템(diff 외부의 컨텍스트, nitpick 필터링, 리뷰 전체의 정합성 등)을 적용하면 격차는 더 벌어집니다. Opus 4.7 통합 점수는 74/100, 베이스라인은 60/100. 상대 개선율 23% 입니다.

이 지표는 단순한 버그 탐지보다 더 미묘한 무언가를 잡아냅니다. 모델이 버그를 발견하긴 했는데, 헷갈리게 설명하거나, 잘못된 라인을 가리키거나, 발견 사항을 무관한 잡음 속에 묻어버리는 경우. 이런 실패 모드들을 풀 시스템 점수는 감점합니다. 그리고 정합성 있고, 정확히 지목하고, PR 전체 맥락에 적절히 맞춰진 리뷰에 가산점을 줍니다. Opus 4.7의 풀 시스템 점수가 합격률보다 더 큰 폭으로 좋아졌다는 사실은, 탐지뿐 아니라 표현(presentation) 품질도 함께 좋아졌음을 의미합니다.

실행 가능 리뷰 비율(Actionable review rate)

640개 코멘트 모두가 평가자에 의해 실행 가능하다고 표시되었습니다. 즉, 각각의 코멘트가 개발자가 실제로 행동을 취할 만한 정보를 충분히 담고 있었다는 뜻입니다. 그러나 EP에 특정한 실행 가능성(타깃 이슈를 직접 다루는가, 아니면 주변부 우려에 그치는가)으로 측정하면, 54%에서 64%로 상승했습니다.

이 차이는 "이 파일 어딘가에 문제가 있어요"라고 말하는 리뷰어와, "42번 줄의 가드 클로즈가 admin 역할 경로를 커버하지 못해서, 47번 줄에서 user가 nil일 때 패닉이 납니다. 다음은 이를 고치는 디프입니다." 라고 말하는 리뷰어의 차이입니다. 둘 다 기술적으로는 실행 가능합니다. 하지만 시간을 절약해 주는 건 두 번째 쪽 뿐입니다.

중요 이슈 산출량(Important-issue yield)

이번 평가에서 가장 인상적인 데이터 포인트 중 하나입니다. Opus 4.7이 생성한 전체 코멘트의 거의 70% 가 중요(important) 로 분류되었습니다. 즉, 스타일 nitpick이나 외형적인 제안이 아니라 실질적인 버그, 보안 리스크, 정합성 문제를 짚어낸 것이죠.

443개의 중요 코멘트 중 367개가 타깃 평가 포인트 너머에서 모델이 자체적으로 발견한 사항이었습니다. 즉, 전체 중요 산출물의 82.8% 가 저희가 짚지 않았는데도 모델이 같은 코드를 리뷰하다 알아서 발견해 낸 것들입니다. 다시 말해, Opus 4.7은 타깃 테스트에 가깝게 동작하는 모델이라기보다는, 여러분이 가리킨 코드를 보다가 주변부 문제까지 자연스럽게 알아채는 꼼꼼한 리뷰어처럼 동작합니다.

참고로, 베이스라인 모델은 총 558개의 코멘트를 생성한 반면, Opus 4.7은 640개로 약 15% 더 많은 양을 생성했습니다. 다만 차별점은 "양"이 아니라 중요 이슈의 밀도(density) 입니다. 잡음만 늘어난 코멘트는 의미가 없지만, "중요한" 코멘트가 늘어난 것은 완전히 다른 이야기입니다.

Opus 4.7이 내부적으로 다른 점

위의 점수들은 Opus 4.7이 "더 낫다"는 사실을 입증합니다. 다음 섹션은 왜 그런지, 그리고 이 모델이 실제로 여러분의 코드를 리뷰할 때 어떤 모습인지를 설명합니다. 저희는 개별 코멘트들을 수없이 읽어보았고, 언어와 코드베이스를 가로질러 일관되게 등장하는 몇 가지 패턴을 발견했습니다.

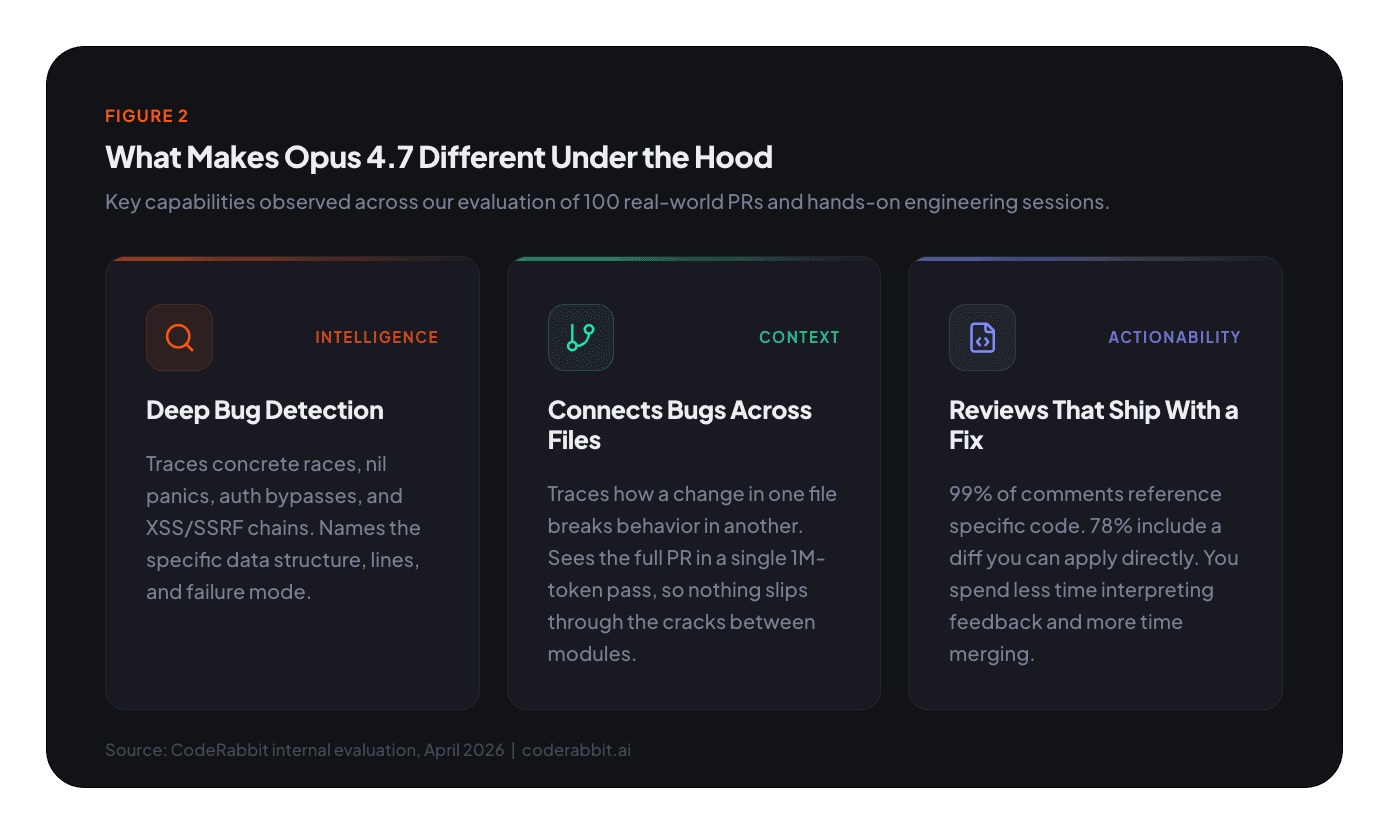

메커니즘 수준의 깊이 있는 버그 탐지

평가 세트 전반에서 모델은 구체적인 레이스 컨디션, nil/패닉 경로, 인가 실패, 블랙리스트 우회, XSS·SSRF 체인, 응답 형태 불일치, 라이프사이클·데이터 손실 버그 등을 일관되게 식별했습니다.

- Go 코드베이스: 고루틴 간의 동시 접근 패턴을 추적해 진짜 레이스 컨디션을 식별. "이거 레이스일 수도 있어요" 수준이 아니라, "고루틴 A가 137번 줄에서

cache.entries에 쓰는 동안, 고루틴 B가 140번 줄에서 동기화 없이 읽고 있어 동시 부하 시 패닉이 발생합니다" 식으로 짚어냅니다. 특정 자료구조, 특정 라인, 특정 실패 모드까지 정확하게. - TypeScript/React: 이벤트 핸들러 라이프사이클을 따라가며 상태 관리 버그를 포착.

useEffect클린업 함수가 비동기 fetch와 어떻게 상호작용하는지 추적하고, 언마운트된 컴포넌트에 stale closure가 상태 업데이트를 일으킬 수 있는 정확한 윈도우를 식별한 뒤, 취소 토큰(cancellation-token) 패턴을 수정안으로 제시. - Ruby on Rails: 파라미터 처리 엣지 케이스에서 발생하는 인증 우회 벡터를 식별. 금요일 오후 인간 리뷰어는 놓치지만, 토요일 공격자는 놓치지 않을 그런 미묘한 허용 범위 문제.

- Java(특히 Keycloak): 서비스 인터페이스와 그 구현 사이의 컨트랙트 불일치를 잡아냄. 여러 단계의 추상화를 거슬러 올라가 런타임 예외가 어디서 표면화될지 추적.

- Python(Sentry): 예외가 너무 광범위하게 catch되어 데이터 처리 파이프라인이 에러를 삼킨 채 불완전한 결과를 반환하는, 어떤 알람도 뜨지 않는 무음 실패 경로를 식별.

파일 간 추론(Cross-file reasoning)

가장 인상적이고, 확장된 컨텍스트 윈도우의 혜택을 가장 크게 받는 능력은 여러 파일을 가로지르는 발견 사항을 연결하는 능력입니다. 어떤 디프가 주어졌을 때, 모델은 헬퍼 수준의 컨트랙트와 다운스트림에서의 깨짐을 연결 짓고, 관련 메서드·핸들러·프로바이더 간 동작을 비교합니다.

Opus 4.7은 PR 작성자가 업데이트하는 것을 잊은 두 다운스트림 호출자가 그 파라미터를 사용 중이라는 사실을 알려주고, 그 중 하나가 이제 디폴트 값으로 조용히 폴백되어 엔터프라이즈 계정의 빌링 계산을 깨뜨릴 것이라는 점까지 짚어 줍니다.

분석 결과 이 패턴이 확인됐습니다. 모델은 "헬퍼 수준 컨트랙트와 다운스트림 깨짐을 연결하고, 관련 메서드·핸들러·프로바이더 간 동작을 비교한다" 는 패턴을 일관되게 보였습니다. 5개의 서로 다른 언어 생태계에 걸친 수십 회의 리뷰 세션에서 동일하게 관찰됐습니다.

패치 중심(patch-oriented) 출력

리뷰 스타일은 극도로 코드 중심적이며, 이 부분이 실무 개발자 경험에서 빛을 발합니다.

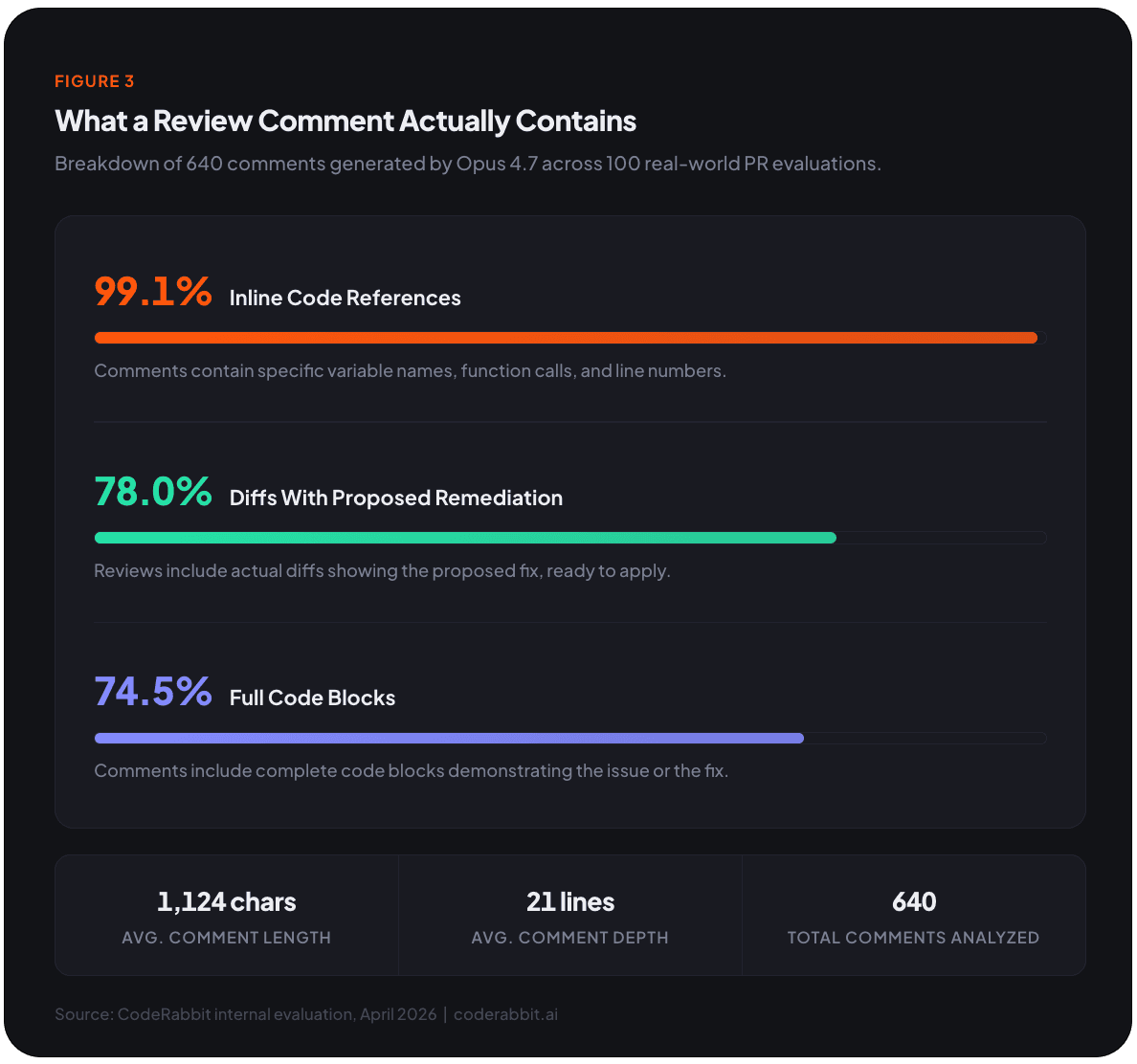

- 99.1% 의 코멘트가 인라인 코드 참조(특정 변수명, 함수 호출, 라인 번호)를 포함

- 74.5% 가 이슈/수정안을 보여주는 전체 코드 블록 포함

- 78.0% 가 실제 디프(diff) 포함

실무에서는 대부분의 코멘트가 즉시 적용 가능한 수정안과 함께 도착합니다. 평균 코멘트 길이는 1,124자, 21줄 수준으로, 스쳐 지나가는 메모라기보다는 작은 디자인 리뷰처럼 읽힙니다. 전형적인 코멘트는 굵은 판결문 스타일의 한 줄 요약("캐시 무효화에서의 레이스 컨디션")으로 시작해, 메커니즘과 영향을 2~3 단락에 걸쳐 압축적으로 설명한 뒤, 접을 수 있는 <details> 블록 안에 구체적인 디프를 담아 마무리됩니다.

톤의 변화: 직설적이고 단호하게

이전 Claude 모델로 코드 리뷰를 해본 사람이라면, Opus 4.7의 톤이 눈에 띄게 달라졌다는 점을 바로 느낄 겁니다. Anthropic은 이를 두고 "더 직설적이고 단호하며, 검증(validation) 위주의 표현이 줄어들었다" 고 설명합니다. 저희의 평가가 이 변화를 정량화합니다.

Opus 4.7 리뷰 코멘트의 단정성(assertiveness)은 77.6%, 회피·완곡 표현(hedging)은 16.5% 에 불과합니다. 굵은 판결문 형식의 요약으로 시작해, 간결한 메커니즘/영향 설명을 거쳐, 구체적인 패치로 끝맺습니다. 언어는 명확한 명령형입니다. "nil을 가드하라", "동시 접근을 방지하라", "입력을 처리 전에 검증하라" 같은 표현이 그 예죠. 망설이는 제안("~을 고려해 보시는 것이 좋겠습니다") 형태가 아닙니다.

톤 분석 요약은 이렇게 정리됩니다. "코멘트들이 작은 코드 리뷰처럼 읽힌다". 판결문 형식의 요약으로 열고, 설명 단락이 이어지고, 구체적인 패치로 닫는 구조죠. 톤은 자신감 있고 지시적이며, 망설임 대신 명확한 명령형을 사용합니다.

메인테이너에게 이는 환영할 만한 변화입니다. 모델이 "nil 체크를 고려해 보세요"가 아니라 "이 입력에서 nil이 들어오면 패닉이 납니다" 라고 말하면, 인지 비용이 줄고 더 빠르게 행동에 옮길 수 있죠. 바쁜 리뷰 큐에서는 이런 직설적임이 하루에 수십 개 코멘트만큼 누적됩니다.

남아 있는 회피 표현도 위치가 적절합니다. 주로 주관적이거나 도메인 특화된 결정에 등장합니다. 예를 들면 현지화(localization) 문자열을 잠재적 오류로 표시하면서 "네이티브 스피커의 확인을 받으시길" 권하는 식이죠. 이는 적절한 겸손입니다. 모델은 근거가 있을 때는 단호하고, 근거가 없을 때는 신중합니다.

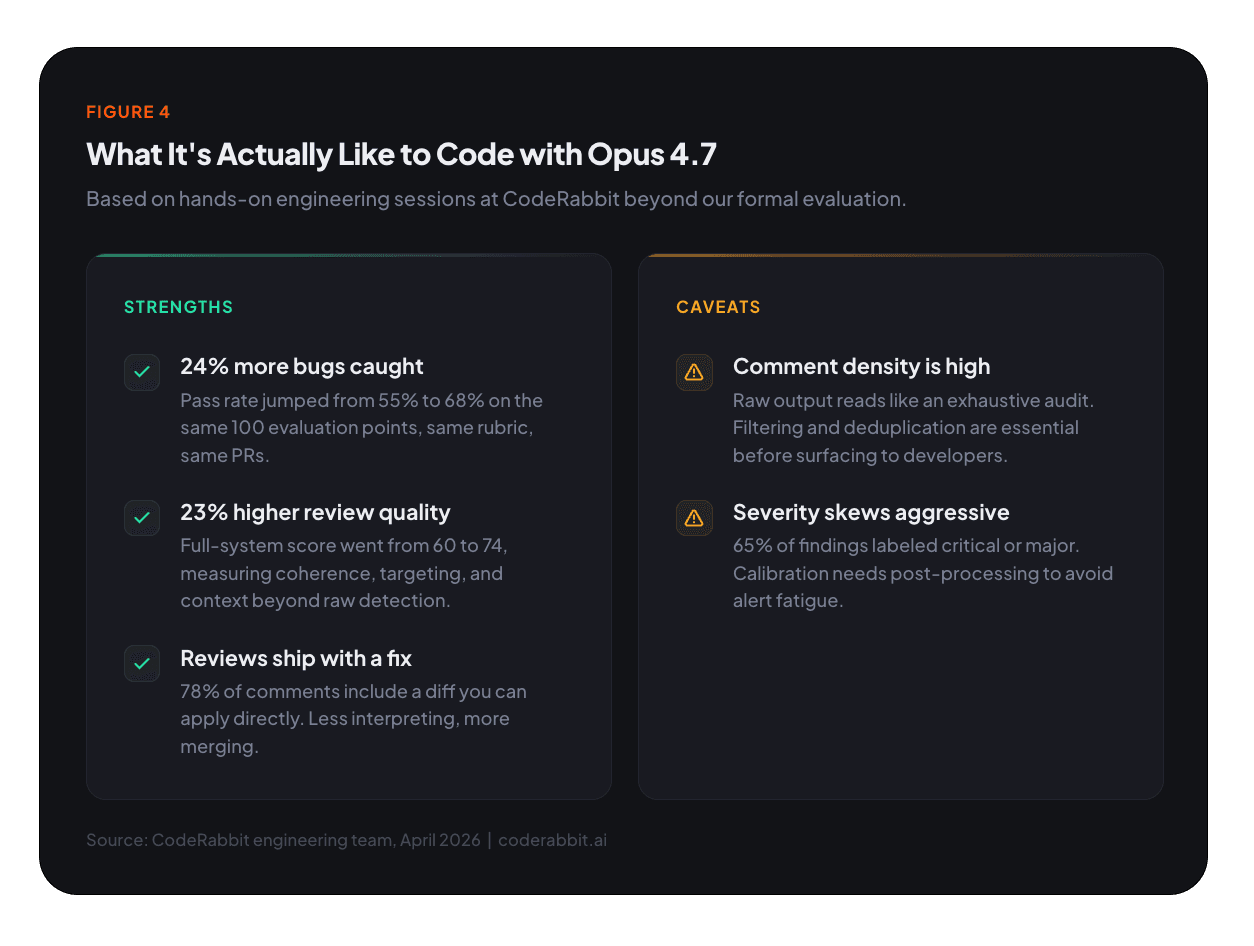

실제 Opus 4.7로 코딩해 보면

벤치마크는 모델이 채점표 위에서 어떻게 동작하는지를 알려줄 뿐, 실제로 옆에 앉혀놓고 무언가를 만들어 보는 느낌을 알려주지는 않습니다. CodeRabbit 엔지니어링 팀이 코드 리뷰를 넘어 일반 코딩 작업에 Opus 4.7을 직접 써 보면서 발견한 패턴들을 공유합니다.

모델이 말을 많이 합니다

가장 먼저 눈에 띄는 점은 모델이 매우 수다스럽다(communicative) 는 사실입니다. 작업하면서 모델이 끊임없이 내레이션을 합니다. 무엇을 하고 있고, 왜 하는지, 어떤 변수를 수정 중인지, 어떤 파일을 건드리는지, 각 단계의 추론은 무엇인지까지요. 그 톤은 친근한 대화체가 아니라 전술적입니다. 모든 토큰이 정보를 실어 나르며, 따뜻함보다는 컨텍스트 전달에 최적화돼 있습니다.

AI 코딩 어시스턴트를 처음 써보는 사용자라면 환영할 만한 특성입니다. 학습 도구 역할을 하는 러닝 코멘터리를 함께 얻는 셈이니까요. 다만, 짧고 끝내자 식의 인터랙션에 익숙한 베테랑 개발자에겐 다소 과하게 느껴질 수 있습니다. 설명을 빠르게 스킵하고 코드 출력에 집중하는 캘리브레이션 기간이 필요합니다.

속도와 추론이 함께 스케일링됩니다

Opus 4.7은 작업 복잡도에 대한 감각이 강합니다. 단순한 작업(변수 이름 바꾸기, 가드 클로즈 추가, 유틸 함수 작성)에서는 빠르게 움직이고, 진짜 어려운 작업(상태 머신 리팩토링, 인증 흐름 재설계, 순환 의존성 정리)에서는 시간을 더 들여 추론합니다. 그 차이가 체감됩니다. 복잡한 작업에서도 전체 속도는 이전 모델 대비 눈에 띄게 빠릅니다. 모델이 "이 작업이 얼마만큼의 사고를 받을 자격이 있는지" 를 이해하고 그에 맞게 자원을 배분하기 때문에, 사소한 일에 과도한 추론을 낭비하지 않습니다.

첫 시도부터 코드 품질이 높습니다

첫 핸즈온 세션 묶음 동안 코드 품질은 일관되게 강했습니다. 초기 탐색 단계에서 거의 버그를 만나지 못했고, "돌긴 도는데 동작은 안 하는" 류의 1차 시도 AI 생성 코드 특유의 실패 모드가 눈에 띄게 드물었습니다.

다만 프론트엔드 작업에는 한 가지 뉘앙스가 있습니다. Opus 4.7은 UX의 "로직" 에 탁월합니다. 요소 배치, 상태 간 흐름, 컴포넌트의 인터랙션 동작 같은 것들이 그렇죠. 그러나 디자인 감각 이 좋은 모델은 아닙니다. 생성된 UI는 기능적이고 잘 구조화돼 있지만, 디자인상을 받지는 못할 수준입니다. 프로토타입이나 내부 도구 용도라면 충분하고, 컨슈머 페이싱 제품이라면 디자인 시스템은 따로 가져오고 모델은 로직 레이어에 활용하는 편이 좋습니다.

지저분한 프롬프트도 잘 알아듣습니다

놀라운 점 하나: Opus 4.7은 부정확한 프롬프트를 해석하는 능력이 뛰어납니다. 완벽하게 구조화된 지시문을 작성할 필요가 없습니다. 모호하거나, 빠진 부분이 있거나, 심지어 약간 모순적인 프롬프트라도 모델은 일반적으로 의도를 추론해 쓸 만한 결과를 만들어냅니다. 실제 업무에서 개발자는 타이핑보다 사고가 빠르게 흐릅니다. 완벽한 프롬프트를 다듬느라 시간을 쓰고 싶어 하지 않죠. Opus 4.7과 함께라면 그럴 필요가 없습니다.

자기 리뷰 루프: 강력하지만 때로는 과합니다

흥미로운 행동 패턴이 하나 있습니다. Opus 4.7은 작업을 마친 뒤 자기 자신의 결과물을 다시 리뷰하곤 합니다. 코드를 생성하고, 이슈를 스캔한 뒤, 발견한 것을 시키지 않아도 스스로 고치려 듭니다. 이 자기 교정 루프는 대단히 가치 있을 수 있습니다. 1차 시도에서 놓쳤던 것을 잡아 최종 출력을 개선해 주거든요.

다만 단점도 있습니다. 가끔 모델이 과하게 생각합니다. 멀쩡한 코드에서 "문제"를 발견했다고 판단하고, 건드릴 필요가 없던 섹션을 다시 만지기 시작합니다. 그 과정에서 불필요한 변경이나 새로운 이슈가 도입되기도 합니다. 모델의 꼼꼼함이 가끔은 과교정(over-correction) 으로 기울어진다는 뜻이죠. 실무 조언은 간단합니다. 모델의 자체 수정도 다른 코드 변경과 똑같은 강도로 리뷰하고, 1차가 이미 맞다면 2차를 망설임 없이 롤백하세요.

의외의 창의적 범위

이건 예상치 못한 부분이었습니다. Opus 4.7은 창작 작업도 진짜로 잘합니다. 제목, 태그라인, 네이밍 제안, 카피라이트 작업을 시켜보면 결과물이 꽤 독창적으로 느껴집니다.

그래픽 작업도 강합니다. 이미지·로고·벡터 그래픽·픽셀 아트 생성에서, 코드와 추론으로 알려진 모델로부터 기대했던 수준을 넘는 품질과 일관성을 보여줍니다. 여러 역할을 동시에 수행하는 개발자(거의 대부분의 저희)에게는, 같은 모델 하나로 코드와 그것을 설명하는 마케팅 페이지를 모두 만들 수 있다는 의미입니다.

Claude Opus 4.7에서 개선이 필요해 보이는 지점

완벽한 모델은 없습니다. 저희도 거친 부분을 직접 발견하시기 전에 솔직하게 짚어드리는 편을 택했습니다.

-

심각도(severity) 캘리브레이션이 공격적입니다. 모델은

critical과major쪽으로 치우치는 경향이 있습니다. 그 라벨이 정당한 경우도 많지만, 모델은 가끔 추측성 보안 표면, 마이그레이션 리스크, 테스트 한정 실패 등에도critical을 붙입니다. 또한 동일한 코멘트 텍스트가 비슷한 컨텍스트에서 다른 심각도 라벨을 받기도 하는데, 이는 저희가 다듬어야 할 어노테이션 안정성 문제입니다. 후처리(post-processing) 파이프라인에서 이를 정상화 중입니다. -

코멘트 밀도가 높습니다. 가공되지 않은 출력은 "포커스된 리뷰"보다는 "감사 보고서(exhaustive audit)" 에 가깝습니다. 모든 PR이 19개의 코멘트를 필요로 하는 건 아닙니다. 저희의 필터링·랭킹·중복 제거 레이어는 이를 개발자에게 압도적이지 않은 사용 가능한 신호로 변환하는 데 필수적입니다.

-

평가 컨텍스트 간 중복 발견. 모델은 가끔 관련 코드 경로 전반에 걸쳐 거의 동일한 코멘트를 만들어냅니다. 예를 들어 비슷한 세 개의 핸들러 함수에 동일한 null-check 경고를 반복적으로 다는 식이죠. 각각은 기술적으로 옳지만, 반복은 커버리지를 부풀려 보이게 만들고 잡음을 늘립니다. 정규화된 텍스트 + 파일/라인 기반의 중복 제거가 필요한 후처리 단계이며, 저희는 30

40개의 raw 코멘트가 중복 제거 후 1020개의 고유 발견으로 압축되는 사례들을 보고 있습니다. -

과교정 본능. 핸즈온 섹션에서 언급한 것처럼, 모델의 자기 리뷰 행동(다른 맥락에서는 강점인)은 가끔 불필요한 재작업으로 이어질 수 있습니다. 코드 리뷰 컨텍스트에서는 이것이 의도적이거나 관용적인 코드 패턴을 잠재적 이슈로 표시하는 형태로 드러납니다. 꼼꼼함은 강점이지만, 언제 멈춰야 하는지에 대한 캘리브레이션은 아직 진행 중입니다.

Opus 4.7 통합이 CodeRabbit 사용자에게 의미하는 것

저희는 Opus 4.7을 리뷰 파이프라인에 활발히 통합하고 있습니다. 롤아웃이 진행되며 여러분이 기대하실 수 있는 것은 다음과 같습니다.

-

머지 전에 더 많은 버그가 잡힙니다. 위에서 자세히 다룬 합격률·풀 시스템 점수의 향상은 곧바로 새어나가는 버그 감소 로 이어집니다. 몇 주, 몇 달이 누적되면 의미 있는 수준의 프로덕션 인시던트 감소, 핫픽스 감소, 새벽 호출 감소로 복리 효과를 냅니다.

-

즉시 행동에 옮길 수 있는 피드백. 대부분의 발견 사항이 인라인 코드와 즉시 적용 가능한 디프와 함께 도착합니다. 그 중 다수는 제안된 변경을 그대로 적용하고, 검토하고, 다음으로 넘어갈 수 있어 코멘트당 분 단위, 주당 시간 단위의 시간을 절약해 줍니다.

-

더 나은 파일 간 인지 능력. PR이 공유 유틸리티를 업데이트하면서 세 개의 호출자 중 하나를 빼먹었다면, Opus 4.7은 이전 모델보다 유의미하게 더 자주 그 점을 짚어냅니다. 복잡한 리팩토링과 멀티파일 변경에 대한 커버리지가 한층 똑똑해집니다.

Opus 4.7은 AI 보조 코드 리뷰의 가능성에 대한 계단형(step function) 도약을 의미합니다. 더 강한 추론, 더 넓은 컨텍스트, 더 실행 가능한 출력, 설정 가능한 깊이. AI 리뷰와 전문가 인간 리뷰 사이의 격차는 계속 좁혀지고 있습니다. AI가 인간 리뷰어를 대체하는 것이 아니라, 인간이 시간이 없어 다루지 못하는 영역을 커버해 주는 방향이죠.

아직 CodeRabbit을 써보지 않으셨다면, 지금이 가장 좋은 타이밍입니다. 2분 안에 레포지토리를 연결할 수 있습니다. 모델이 훨씬 똑똑해졌고, 여러분의 코드 리뷰도 그만큼 똑똑해졌습니다.

다른 모델 비교 결과가 궁금하시다면 GPT-5.5 벤치마크 결과와 Gemini 3.1 Pro 코드 리뷰 벤치마크를 함께 보시기를 추천 드립니다. 사람과 AI 코드 리뷰의 분업 가이드는 AI 코드 리뷰 vs 사람 코드 리뷰에서 확인하실 수 있습니다.